하라는대로 하는 중

install.sh를 통해 esp32를 하면 esp32-c/h/s2/s3 쪽은 지원하지 않으니 all을 하면 다 설치할 수도 있다고 한다.

나야 esp32만 쓸꺼나 상관없음

| $ sudo apt-get install git wget flex bison gperf python3 python3-pip python3-venv cmake ninja-build ccache libffi-dev libssl-dev dfu-util libusb-1.0-0 $ git clone https://github.com/espressif/esp-idf.git ~/src/esp$ cd esp-idf/ ~/src/esp/esp-idf$ ./install.sh esp32 All done! You can now run: . ./export.sh ~/src/esp/esp-idf$ . ./export.sh Done! You can now compile ESP-IDF projects. Go to the project directory and run: idf.py build |

[링크 : https://docs.espressif.com/projects/esp-idf/en/latest/esp32/get-started/linux-macos-setup.html]

'embeded > esp32' 카테고리의 다른 글

| esp32 at 소스 빌드(윈도우) (0) | 2023.12.19 |

|---|---|

| esp32 at source 빌드(리눅스) (0) | 2023.12.19 |

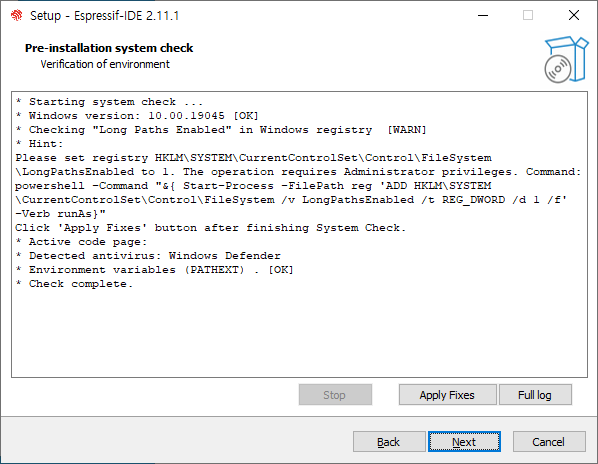

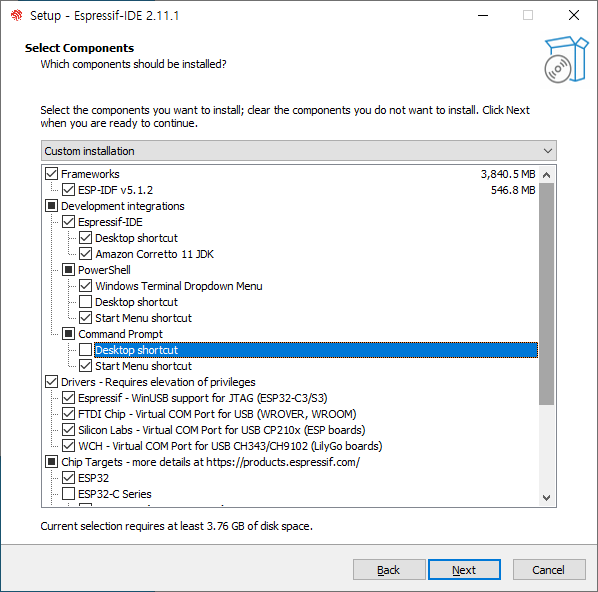

| esp32 idf on windows (0) | 2023.12.18 |

| esp32 uart 포트 바꾸기 (0) | 2023.12.16 |

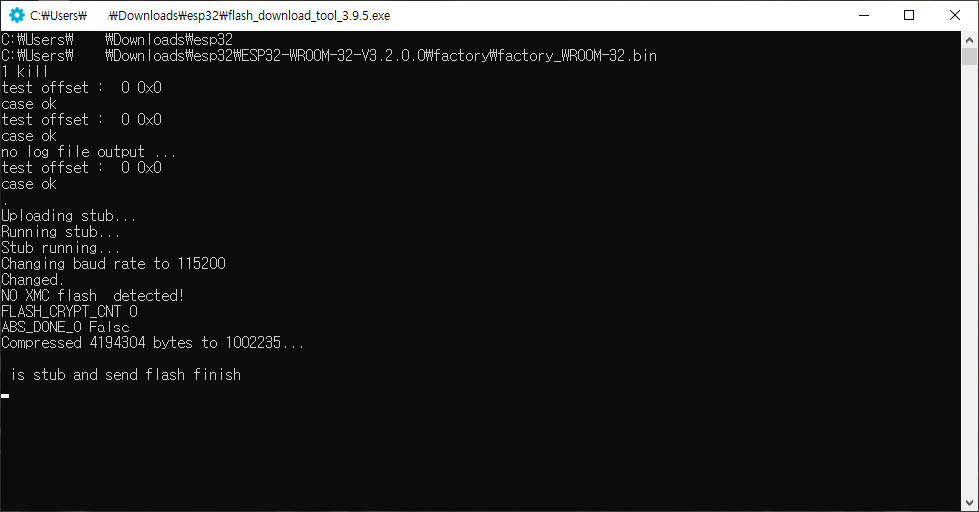

| esp32-cam에 AT 펌웨어 넣기만 성공 (0) | 2023.12.15 |